Indice

- Riepilogo Esecutivo e Risultati Chiave

- Panorama di Mercato e Previsioni di Crescita (2025–2030)

- Technologie Fondamentali nella Modellazione Cinematica dei Tessuti Molli

- Integrazione con Piattaforme Chirurgiche Robotiche

- Aziende Leader e Partnership Strategiche

- Applicazioni Cliniche e Casi d’Uso

- Sviluppi Normativi e di Standard

- Finitechi in Accuratezza di Modellazione e Performance in Tempo Reale

- Tendenze Emergenti: AI, Simulazione e Approcci al Gemello Digitale

- Prospettive: Direzioni Future e Opportunità (2025–2030)

- Fonti e Riferimenti

Riepilogo Esecutivo e Risultati Chiave

La modellazione cinematica dei tessuti molli è diventata un abilitante critica nell’evoluzione continua della chirurgia robotica, con il 2025 che segna un punto di svolta per la sua adozione e maturità tecnologica. Con l’espansione delle procedure assistite da robot nella chirurgia generale, urologica, ginecologica e cardiotoracica, la necessità di una modellazione accurata e in tempo reale della deformazione dei tessuti molli è fondamentale per la precisione, la sicurezza e il miglioramento dei risultati dei pazienti.

Negli ultimi dodici mesi, i leader del settore hanno accelerato l’integrazione di modelli computazionali avanzati e intelligenza artificiale (AI) nelle loro piattaforme robotiche. www.intuitive.com ha introdotto miglioramenti al suo sistema da Vinci, sfruttando la modellazione cinetica per migliorare il feedback sull’interazione strumento-tessuto e il controllo del movimento adattivo. Allo stesso modo, www.medtronic.com ha incorporato algoritmi di tracciamento dei tessuti molli nel suo sistema chirurgico assistito dal robot Hugo™, supportando manipolazioni più sfumate in anatomie variabili.

Le collaborazioni di ricerca con centri accademici hanno prodotto risultati promettenti nella modellazione basata su dati, utilizzando imaging intraoperatorio e fusione di sensori. Ad esempio, il www.surgicalroboticslab.nl ha dimostrato modelli ibridi basati sulla fisica e sull’apprendimento automatico che possono prevedere il movimento dei tessuti molli in tempo reale, influenzando direttamente la pianificazione e la navigazione chirurgica.

I risultati chiave per il 2025 includono:

- Rapidi miglioramenti nella velocità e fedeltà della modellazione dei tessuti molli, con latenza inferiore a 100 millisecondi nelle piattaforme leader, consentendo aggiornamenti quasi istantanei durante la chirurgia.

- Maggiore adozione della modellazione potenziata dall’AI, evidenziata da partnership come quella tra www.siemens-healthineers.com e produttori di dispositivi medici per integrare la previsione della deformazione dei tessuti guidata da AI nei flussi di lavoro di imaging.

- Emergenza di framework di modellazione open-source e interoperabili, come quelli promossi dalla comunità www.ros.org, che promuovono la standardizzazione e accelerano l’innovazione nel settore.

- Maggiore impegno normativo; la www.fda.gov sta attivamente sviluppando linee guida per tecnologie di AI e modellazione nella chirurgia robotica, facilitando un percorso più chiaro per l’adozione clinica.

Guardando al futuro, il consenso nel settore suggerisce che entro il 2027, la modellazione cinematica dei tessuti molli specifica per il paziente e in tempo reale sarà una caratteristica standard nei nuovi sistemi di chirurgia robotica di generazione futura. Questo progresso si prevede ridurrà ulteriormente i tassi di complicanze, abbreviterà le curve di apprendimento per i chirurghi e amplierà la gamma di procedure suscettibili di assistenza robotica, migliorando infine la cura chirurgica globale.

Panorama di Mercato e Previsioni di Crescita (2025–2030)

Il panorama di mercato per la modellazione cinematica dei tessuti molli nella chirurgia robotica sta evolvendo rapidamente, spinto dai progressi nella modellazione computazionale, integrazione dei sensori e intelligenza artificiale. Nel 2025, l’adozione di soluzioni di modellazione dei tessuti molli sta accelerando in parallelo con il mercato più ampio della chirurgia robotica, che continua ad espandersi sia in volume che in sofisticazione. Questa crescita è guidata dalla domanda di maggiore precisione chirurgica, riduzione del trauma per i pazienti e miglioramento dei risultati post-operatori—benefici direttamente collegati alla modellazione in tempo reale e specifica per il paziente del comportamento dei tessuti molli.

Attori chiave del settore come www.intuitive.com, corporate.olympus-global.com e www.medtronic.com stanno espandendo i loro sforzi di R&D per integrare la cinematica avanzata dei tessuti molli nelle loro piattaforme. Ad esempio, i sistemi da Vinci di Intuitive Surgical stanno sempre più incorporando capacità di imaging avanzato e feedback di forza progettate per facilitare la modellazione in tempo reale della deformazione dei tessuti. Allo stesso modo, il sistema chirurgico assistito dal robot Hugo™ di Medtronic sta venendo posizionato per sfruttare modelli basati su dati per un controllo più intuitivo del chirurgo e una migliore decision-making intraoperatoria. Nel frattempo, Olympus sta investendo in piattaforme di imaging medico e endoscopiche che possono essere sinergizzate con moduli di simulazione dei tessuti molli, mirando a fornire intuizioni predittive durante le procedure minimamente invasive.

Collaborazioni tra accademici e industria stanno catalizzando l’innovazione in questo spazio. Iniziative come il www.surgicalroboticslab.nl stanno lavorando insieme a partner commerciali per perfezionare i modelli bio-meccanici da implementare nei sistemi chirurgici robotici clinici. Si prevede che queste collaborazioni matureranno in soluzioni disponibili commercialmente nei prossimi anni, allineandosi con le tendenze del settore verso una maggiore automazione e digitalizzazione in sala operatoria.

Dal punto di vista della crescita, l’integrazione della modellazione cinematica dei tessuti molli è prevista superare progetti pilota e prototipi di ricerca verso una più ampia adozione clinica entro il 2030. Man mano che i robot chirurgici diventano più prevalenti negli ospedali di tutto il mondo, anche i percorsi di approvazione normativi si stanno semplificando; la Food & Drug Administration degli Stati Uniti (www.fda.gov) sta attivamente coinvolgendo le parti interessate per stabilire standard per la sicurezza e l’efficacia della modellazione guidata da AI nella chirurgia robotica. Questa chiarezza normativa è prevista accelerare gli investimenti e la commercializzazione.

In sintesi, tra il 2025 e il 2030, la modellazione cinematica dei tessuti molli è pronta a passare da una caratteristica distintiva a un requisito fondamentale per i sistemi di chirurgia robotica di nuova generazione. Questo cambiamento sbloccherà nuove opportunità di mercato per i fornitori di tecnologia e migliorerà drammaticamente i risultati chirurgici in tutto il mondo, segnando una nuova era di precisione e personalizzazione nelle cure operative.

Tecnologie Fondamentali nella Modellazione Cinematica dei Tessuti Molli

La modellazione cinematica dei tessuti molli rappresenta un pilastro nell’avanzamento della chirurgia robotica, abilitando una manipolazione precisa, una pianificazione e un’interazione in tempo reale con tessuti biologici deformabili. Nel 2025, il campo è caratterizzato da una rapida integrazione della modellazione computazionale, delle tecnologie di rilevamento e dell’intelligenza artificiale (AI) per affrontare le sfide intrinseche poste dal comportamento complesso, non lineare e specifico del paziente dei tessuti molli durante le procedure chirurgiche.

Una tecnologia fondamentale è la modellazione ad elementi finiti (FEM), che permette una simulazione ad alta fedeltà della deformazione dei tessuti sotto vari forze. Aziende come www.intuitive.com, produttori del sistema chirurgico da Vinci, hanno sviluppato algoritmi proprietari per assistere con la guida intraoperatoria, sfruttando i dati di imaging preoperatorio per creare modelli specifici per il paziente per una pianificazione chirurgica migliorata. I recenti progressi si concentrano sul calcolo FEM in tempo reale, consentendo aggiustamenti adattativi mentre i tessuti vengono manipolati durante l’intervento chirurgico.

A complemento della FEM, le tecnologie di tracciamento dei tessuti in tempo reale utilizzano modalità di imaging avanzate come l’ecografia intraoperatoria e la tomografia a coerenza ottica (OCT). Ad esempio, www.sss.us integra imaging ad alta risoluzione con i propri sistemi robotici per aggiornare dinamicamente i modelli di deformazione dei tessuti molli, fornendo ai chirurghi visualizzazioni accurate e aggiornate del campo operativo.

L’apprendimento automatico (ML) e l’AI sono sempre più integrati nelle piattaforme di modellazione, abilitando cinematica predittiva e movimenti compensatori del robot. www.cmrsurgical.com sta sviluppando attivamente algoritmi guidati da AI per la propria piattaforma Versius che prevedono il comportamento dei tessuti basato su dati di sensori in tempo reale, mirando a ridurre il trauma e ottimizzare il posizionamento dei punti di sutura. Questi modelli AI sono addestrati su ampi dataset di video chirurgici e dati di sensori di forza, e sono validati attraverso studi clinici in corso.

I sistemi di feedback aptico costituiscono un altro componente fondamentale, traducendo i dati cinetici complessi in indizi tattili per il chirurgo. Aziende come www.medtronic.com hanno introdotto interfacce aptiche avanzate nel loro sistema Hugo™ RAS, consentendo un feedback di forza in tempo reale che riflette la resistenza del tessuto modello, migliorando così la destrezza chirurgica e riducendo il rischio di danni involontari.

Le prospettive per i prossimi anni indicano una maggiore convergenza di queste tecnologie, con un forte emphasis sulla personalizzazione, automazione e controllo a circuito chiuso. Le collaborazioni in corso tra produttori di dispositivi, laboratori di ricerca accademici e fornitori di tecnologia di imaging sono previste per produrre soluzioni robusti, approvate dalle normative, per la modellazione dei tessuti molli. Inoltre, si prevede che l’integrazione del calcolo basato sul cloud e l’apprendimento federato acceleri il miglioramento e la trasferibilità dei modelli tra diverse popolazioni di pazienti e procedure chirurgiche.

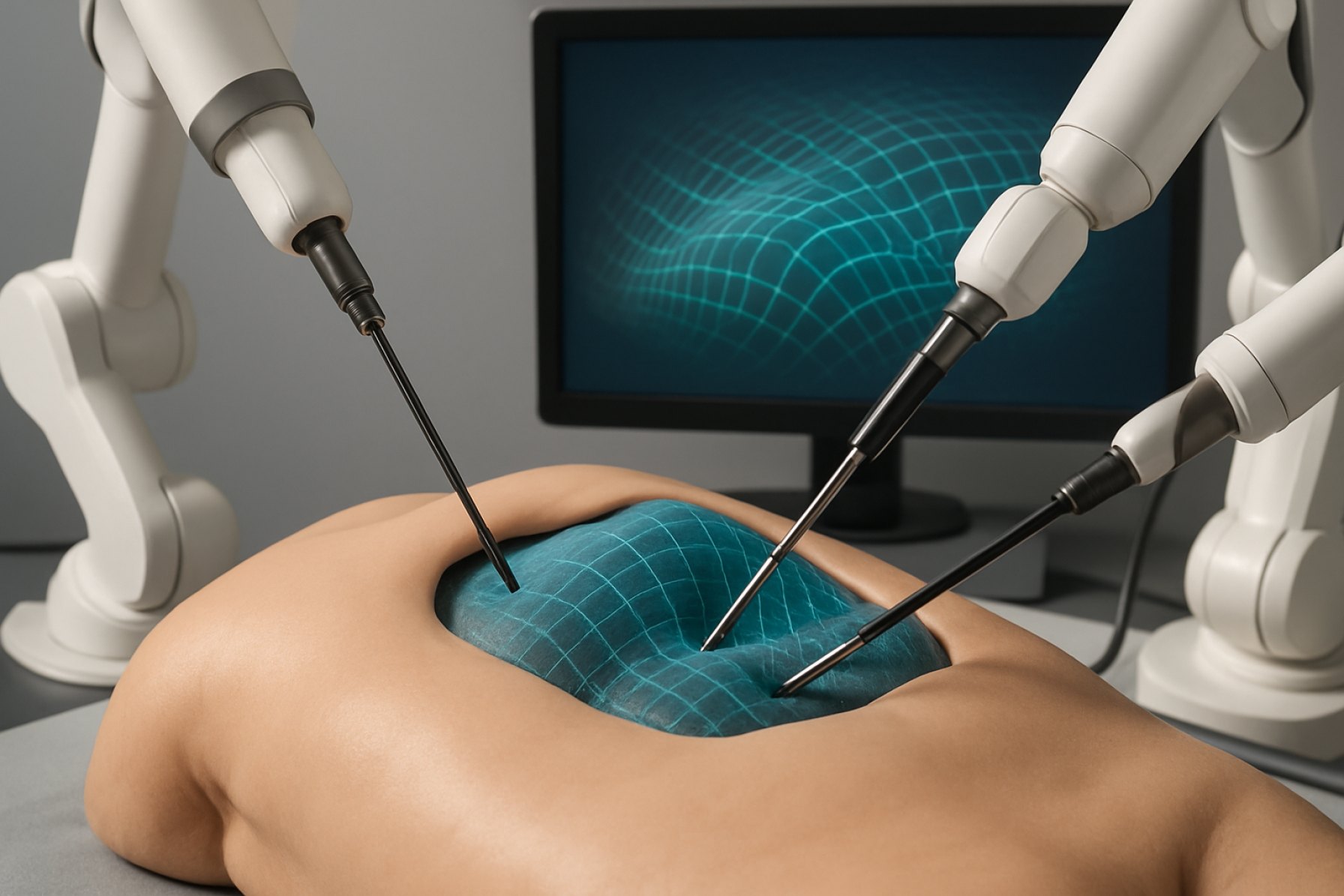

Integrazione con Piattaforme Chirurgiche Robotiche

L’integrazione della modellazione cinematica dei tessuti molli nelle piattaforme chirurgiche robotiche sta accelerando significativamente nel 2025, spinta sia dai progressi tecnologici che dalla crescente domanda clinica di maggiore precisione chirurgica. I moderni sistemi robotici fanno sempre più affidamento sulla modellazione in tempo reale della deformazione dei tessuti per migliorare il feedback al chirurgo, la guida degli strumenti e il decision-making intraoperatorio. I principali attori del settore, come www.intuitive.com e www.medtronic.com, stanno attivamente incorporando, o pilotando, moduli di modellazione cinetica all’interno delle loro piattaforme di punta.

Un aspetto centrale di questa integrazione è l’uso di imaging avanzato (es. ecografia intraoperatoria, endoscopia in tempo reale) e fusione di sensori per parametizzare la dinamica dei tessuti molli. Ad esempio, www.intuitive.com sta valutando algoritmi di apprendimento automatico che si adattano alle caratteristiche specifiche del tessuto del paziente, consentendo una manipolazione più reattiva e riducendo il rischio di lesioni accidentali. Allo stesso modo, www.medtronic.com è progettato con compatibilità per potenziamenti software di terze parti, aprendo la strada all’integrazione della modellazione cinetica in tempo reale come aggiornamento software.

Le collaborazioni accademiche stanno anche alimentando l’innovazione in questo spazio. All’inizio del 2025, www.siemens-healthineers.com ha annunciato partnership con diversi ospedali universitari per testare algoritmi di tracciamento dei tessuti molli basati su AI, mirando a integrarli direttamente nei sistemi di navigazione chirurgica. Questi sforzi stanno essendo accoppiati con prove cliniche nel mondo reale per convalidare la sicurezza e le prestazioni, specialmente in procedure complesse che coinvolgono organi ad alta mobilità come il fegato o i polmoni.

L’interoperabilità rimane una sfida e un’opportunità centrale. Gruppi di settore come www.aami.org stanno attualmente elaborando standard di interoperabilità che permetteranno ai dati di modellazione cinetica di essere scambiati senza soluzione di continuità tra diverse piattaforme robotiche, dispositivi di imaging e sistemi di registrazione ospedaliera. Questo è previsto accelerare l’adozione della modellazione cinetica, creando un ecosistema più unificato per la chirurgia minimamente invasiva, guidata dai dati.

Guardando ai prossimi anni, le prospettive sono per una maggiore integrazione della modellazione cinematica dei tessuti molli come componente essenziale delle piattaforme di chirurgia robotica. Con gli organismi di regolamentazione che mostrano un crescente supporto per la guida chirurgica digitalmente migliorata, e con i principali fornitori che ora integrano queste capacità in modo nativo, è probabile che entro la fine del decennio, la modellazione dei tessuti molli in tempo reale sarà una caratteristica standard tra i sistemi di chirurgia robotica leader.

Aziende Leader e Partnership Strategiche

Il panorama della modellazione cinematica dei tessuti molli per la chirurgia robotica è plasmato da collaborazioni tra i principali produttori di chirurgia robotica, aziende di tecnologia imaging avanzate e istituzioni mediche orientate alla ricerca. Con l’aumentare della domanda di maggiore precisione e adattabilità nelle procedure minimamente invasive, i leader del settore stanno intessendo alleanze strategiche per integrare una modellazione migliorata nelle loro piattaforme chirurgiche.

Uno dei maggiori attori in questo dominio è www.intuitive.com, rinomata per il suo Sistema Chirurgico da Vinci. Negli ultimi anni, Intuitive ha accelerato gli sforzi per migliorare la modellazione dei tessuti molli collaborando con aziende di tecnologia imaging e centri di ricerca accademici. Nel 2024, Intuitive ha annunciato una collaborazione con www.siemens-healthineers.com per sviluppare congiuntamente soluzioni di imaging intraoperatorie in tempo reale che migliorano l’accuratezza del tracciamento dei tessuti molli durante le procedure assistite da robot. Questa partnership mira a unire le piattaforme di imaging avanzato di Siemens con i sistemi robotici di Intuitive per una modellazione della deformazione dei tessuti più dinamica e reattiva.

Un’altra azienda notevole, www.medtronic.com, continua a investire nel suo sistema di chirurgia assistita da robot Hugo™ integrando algoritmi di modellazione dei tessuti molli guidati da AI. Nel 2025, Medtronic ha ampliato la sua partnership strategica con www.philips.com per sfruttare le capacità di imaging e navigazione in tempo reale di Philips, mirando a fornire cinematica predittiva e visualizzazione aumentata del comportamento dei tessuti durante procedure complesse. Questa integrazione è prevista migliorare il feedback del sistema e la fiducia del chirurgo, in particolare in ambienti tissutali variabili.

Le startup e le imprese orientate alla ricerca stanno anche facendo significativi contributi. www.robocath.com, un’azienda francese specializzata in robotica vascolare, ha avviato partnership con ospedali universitari europei per affinare i modelli di interazione dei tessuti molli per applicazioni endovascolari. Nel frattempo, www.cmr-surgical.com, con il suo sistema Versius, ha collaborato con istituzioni di ricerca britanniche per co-sviluppare modelli di apprendimento automatico che prevedono la risposta dei tessuti molli, mirando a una manipolazione robotica più sicura e adattativa.

Guardando al futuro, queste alleanze strategiche sono previste accelerare la traduzione della modellazione cinematica avanzata dei tessuti molli dai laboratori di ricerca alle sale operatorie. La collaborazione tra i produttori di sistemi robotici, i leader dell’imaging e i partner accademici è destinata a definire la prossima generazione di robotica chirurgica—abilitando interventi più intelligenti, contestualmente consapevoli e specifici per il paziente negli anni a venire.

Applicazioni Cliniche e Casi d’Uso

La modellazione cinematica dei tessuti molli sta avanzando rapidamente le applicazioni cliniche della chirurgia robotica, abilitando interventi precisi, adattativi e minimamente invasivi. Nel 2025, l’integrazione di modelli di deformazione dei tessuti molli in tempo reale è diventata sempre più fattibile grazie ai miglioramenti nella potenza computazionale, nella fusione dei sensori e nell’intelligenza artificiale. Questi sviluppi hanno un impatto diretto su specialità chirurgiche come urologia, ginecologia, chirurgia generale e procedure cardiotoraciche.

Una delle piattaforme più prominenti, il Sistema Chirurgico da Vinci, sviluppato da www.intuitive.com, sta incorporando algoritmi basati su apprendimento automatico per il tracciamento dei tessuti e la modellazione predittiva. Queste funzionalità consentono al sistema di compensare il movimento e la deformazione dei tessuti durante procedure come la prostatectomia e la nefrectomia parziale, portando a una maggiore precisione dei margini e riduzione delle complicanze.

Un altro sforzo pionieristico proviene da www.medtronic.com con il suo sistema di Chirurgia Assistita da Robot Hugo™. Il sistema Hugo sfrutta dati in tempo reale provenienti da imaging endoscopico e sensori di feedback aptico per modellare dinamicamente il comportamento dei tessuti molli. Questa capacità è attualmente in fase di sperimentazione in contesti clinici per migliorare la precisione in chirurgia colorettale e ginecologica, con primi risultati che indicano riduzioni nei tempi di intervento e nei periodi di recupero post-operatori.

Parallelamente, la piattaforma www.cmrsurgical.com sta dimostrando l’integrazione della modellazione cinematica dei tessuti molli per ottimizzare il posizionamento dei porti e la traiettoria degli strumenti, in particolare in procedure complesse multi-quadrant. Il design modulare del sistema consente aggiornamenti iterativi ai suoi algoritmi di modellazione, e recenti casi d’uso clinici hanno mostrato vantaggi nella riduzione delle lesioni iatrogene e nel miglioramento dell’efficienza del flusso di lavoro.

I centri medici accademici e gli ospedali di ricerca stanno anche collaborando con partner del settore per convalidare queste tecnologie in prove cliniche nel mondo reale. Ad esempio, www.mayo.edu sta lavorando su pipeline di modellazione dei tessuti guidate da AI per guidare il suturing robotico e la resezione nelle chirurgia epatobiliare, mirando a minimizzare ulteriormente l’errore umano e standardizzare i risultati.

Guardando al futuro, si prevede che la modellazione cinematica dei tessuti molli faciliti la prossima generazione di interventi robotici autonomi e semi-autonomi. Questi progressi potrebbero estendersi a procedure complesse come la riparazione delle valvole cardiache e il trapianto d’organo, dove l’interazione dinamica dei tessuti è critica. Man mano che i quadri normativi e gli standard di interoperabilità dei dati maturano, si prevede che l’adozione clinica di queste tecnologie acceleri, con studi multicentrici e sorveglianza post-marketing che plasmeranno il loro impatto a lungo termine sulla sicurezza del paziente e sull’efficacia chirurgica.

Sviluppi Normativi e di Standard

Il panorama normativo per la modellazione cinematica dei tessuti molli nella chirurgia robotica sta evolvendo rapidamente, poiché l’integrazione di tecnologie avanzate di simulazione e guidate da AI diventa centrale per le procedure minimamente invasive. Le agenzie di regolamentazione stanno riconoscendo sempre più la necessità di quadri chiari per valutare la sicurezza, l’efficacia e l’interoperabilità di queste soluzioni di modellazione, critiche per la navigazione chirurgica in tempo reale e il miglioramento dei risultati del paziente.

Nel 2024 e nel 2025, la www.fda.gov ha avanzato il proprio approccio alla sorveglianza di software di intelligenza artificiale (AI) e di apprendimento automatico (ML) come dispositivi medicali (SaMD), inclusi quelli alla base della modellazione cinematica dei tessuti molli. L’agenzia sta pilotando un “Piano di Controllo dei Cambiamenti Predeterminati” che consente ai modelli basati su AI—come quelli che prevedono o simulano la deformazione dei tessuti molli durante la chirurgia robotica—di essere aggiornati post-approvazione sotto condizioni pre specificate, supportando l’innovazione continua pur mantenendo la sicurezza del paziente.

Nel frattempo, la ec.europa.eu continua a stabilire requisiti rigorosi per la valutazione clinica e la sorveglianza post-mercato dei dispositivi medici, inclusi i sistemi di chirurgia robotica che impiegano modellazione dei tessuti in tempo reale. L’UE sta ulteriormente armonizzando gli standard di valutazione della salute digitale, con organizzazioni come www.medtecheurope.org che lavorano con le parti interessate per chiarire le aspettative per i componenti di AI e simulazione utilizzati nei robot chirurgici.

- Nel 2024, www.intuitive.com ha annunciato miglioramenti alla sua piattaforma da Vinci e al sistema endoluminale Ion, incorporando strumenti di modellazione e simulazione guidati da AI per la manipolazione dei tessuti molli. Le approvazioni regolatorie per queste funzionalità sono guidate da quadri in evoluzione della FDA e dell’UE riguardo gli aggiornamenti software, la trasparenza e la validazione dei modelli cinetici.

- www.cmrsurgical.com e altri leader del settore stanno attivamente coinvolgendo organismi di regolamentazione per stabilire le migliori pratiche per la validazione e il testing clinico degli algoritmi di simulazione dei tessuti molli, riconoscendo che la generazione di prove robuste è essenziale per le future approvazioni.

- I consorzi di settore come www.aami.org stanno sviluppando nuovi standard tecnici specifici per la qualità software, la precisione della modellazione in tempo reale e i fattori umani nella chirurgia robotica, mirando a un allineamento internazionale.

Guardando al futuro, nei prossimi anni è probabile che i regolatori rilascino linee guida più dettagliate specifiche per la modellazione cinetica potenziata dall’AI, inclusi i requisiti per la provenienza dei dati, gli algoritmi di apprendimento continuo e l’interoperabilità con i sistemi chirurgici esistenti. Questi sviluppi sono previsti per accelerare l’adozione sicura delle tecnologie di modellazione dei tessuti molli di nuova generazione, promuovendo maggiore fiducia tra i clinici e i pazienti.

Sfide nell’Accuratezza della Modellazione e nelle Performance in Tempo Reale

La modellazione cinematica dei tessuti molli per la chirurgia robotica affronta sfide persistenti e complesse nel raggiungere sia un’alta accuratezza che performance in tempo reale, specialmente man mano che il campo avanza nel 2025 e oltre. Le proprietà intrinseche dei tessuti molli—non linearità, viscoelasticità, anisotropia e eterogeneità—rendono fondamentalmente difficile la modellazione accurata. Inoltre, queste proprietà possono variare significativamente tra i pazienti e persino all’interno di diverse aree dello stesso organo durante la chirurgia, complicando lo sviluppo di modelli robusti e generalizzabili.

Una sfida principale risiede nelle esigenze computazionali di simulare la deformazione dei tessuti molli in tempo reale. I metodi tradizionali ad elementi finiti (FEM) e i modelli basati sulla fisica offrono un’alta accuratezza, ma sono spesso troppo intensivi dal punto di vista computazionale per applicazioni intraoperatorie senza una sostanziale semplificazione, il che introduce compromessi nella precisione. Mentre aziende come www.intuitive.com e www.cmrsurgical.com stanno sviluppando attivamente piattaforme robotiche avanzate, si basano su modelli semplificati o basati su dati per affrontare queste restrizioni in tempo reale.

Negli ultimi anni si è assistito a una crescente integrazione delle tecniche di apprendimento automatico per approssimare la meccanica dei tessuti e prevedere la deformazione, fornendo tempi di inferenza più rapidi. Tuttavia, questi modelli sono altamente dipendenti dalla quantità e diversità dei dati di addestramento, che rimangono limitati a causa di preoccupazioni sulla privacy, la difficoltà logistica di ottenere dati intraoperatori e la variabilità nelle proprietà dei tessuti. Sforzi da parte di organizzazioni come il www.surgicalroboticschallenge.org hanno stimolato iniziative di benchmarking collaborative, ma dataset standardizzati rimangono scarsi nel 2025.

L’integrazione dei sensori rappresenta un altro collo di bottiglia. Il feedback in tempo reale da sensori di forza, telecamere stereo e imaging intraoperatorio (es. ecografia) è vitale per l’aggiornamento dinamico dei modelli. Tuttavia, al 2025, l’accuratezza, la latenza e la miniaturizzazione di questi sensori—offerti da fornitori come www.ati-ia.com—stanno ancora maturando per soddisfare gli stringenti requisiti dei sistemi chirurgici clinici. Inoltre, il movimento dei tessuti molli dovuto a processi fisiologici come la respirazione e il battito cardiaco aggiunge ulteriore imprevedibilità, necessitando di algoritmi adattativi capaci di apprendimento continuo e aggiustamento durante la chirurgia.

Guardando avanti, si prevede che i prossimi anni porteranno miglioramenti incrementali. I progressi nel calcolo GPU, nell’AI edge e nella tecnologia dei sensori sono previsti per migliorare le performance in tempo reale dei modelli cinetici. Framework collaborativi e iniziative open-source probabilmente faciliteranno la creazione di dataset più ricchi per l’addestramento e la validazione dei modelli. Tuttavia, raggiungere una modellazione robusta, in tempo reale e specifica per il paziente della cinematica dei tessuti molli rimane una sfida formidabile che continuerà a guidare ricerca e innovazione nelle piattaforme di chirurgia robotica.

Tendenze Emergenti: AI, Simulazione e Approcci al Gemello Digitale

Il panorama della modellazione cinematica dei tessuti molli per la chirurgia robotica sta subendo una rapida trasformazione, guidata dai progressi nell’intelligenza artificiale (AI), nella simulazione di alta fedeltà e nelle tecnologie dei gemelli digitali. Nel 2025, queste innovazioni stanno affrontando sfide di lunga data nella previsione e replica accurata del comportamento complesso e non lineare dei tessuti molli durante le procedure minimamente invasive.

La modellazione potenziata dall’AI è in prima linea, consentendo ai sistemi robotici di elaborare vasti dataset intraoperatori per un’adattamento in tempo reale. Aziende come www.intuitive.com stanno integrando algoritmi di apprendimento automatico nelle loro piattaforme per migliorare la classificazione dei tessuti, il feedback di forza e la pianificazione del movimento. Questi modelli sono addestrati su ampie repository di dati chirurgici, consentendo ai robot di anticipare meglio la deformazione dei tessuti e regolare dinamicamente le traiettorie degli strumenti. Ciò si traduce in una maggiore precisione e sicurezza, specialmente in ambienti delicati come la neurochirurgia e gli interventi cardiaci.

Le piattaforme di simulazione stanno diventando sempre più sofisticate, con modelli basati sulla fisica e guidati dai dati ora in grado di replicare le proprietà viscoelastiche degli organi in ambienti virtuali. www.siemens-healthineers.com e www.medtronic.com stanno sfruttando questi modelli per la pianificazione preoperatoria e la prova, consentendo ai chirurghi di esercitarsi su repliche digitali specifiche per il paziente. Queste simulazioni non solo migliorano i risultati chirurgici, ma servono anche come strumenti di formazione preziosi, accelerando la curva di apprendimento per nuove procedure e tecnologie.

Una tendenza emergente significativa è l’implementazione della tecnologia del gemello digitale—una rappresentazione virtuale in tempo reale dell’anatomia e del comportamento dei tessuti del paziente, continuamente aggiornata con i dati intraoperatori. www.philips.com ha recentemente introdotto un gemello digitale potenziato da AI per la cura cardiaca, che esemplifica il potenziale della modellazione dinamica dei tessuti molli durante la chirurgia. Questi gemelli digitali abilitano analisi predittive, fornendo ai chirurghi intuizioni utilizzabili, come la stima dello spostamento o della tensione dei tessuti basata su manipolazioni robotiche.

Guardando avanti, gli sforzi si stanno concentrando sull’integrazione dei dati multimodali—combinando imaging intraoperatorio, feedback aptico e proprietà bio-meccaniche specifiche del paziente per affinare ulteriormente i modelli cinetici dei tessuti molli. Le collaborazioni industriali tra aziende di robotica e centri medici accademici stanno accelerando lo sviluppo di piattaforme open-source e standard interoperabili, favorendo un’adozione più ampia. Man mano che i quadri normativi evolvono per accogliere questi progressi, i prossimi anni sono destinati a vedere una crescente traduzione clinica, con sistemi robotici supportati da AI e simulazioni che pongono nuovi standard per la precisione chirurgica e la sicurezza del paziente.

Prospettive: Direzioni Future e Opportunità (2025–2030)

Le prospettive per la modellazione cinematica dei tessuti molli nella chirurgia robotica tra il 2025 e il 2030 sono pronte per un significativo avanzamento, sostenuto da rapidi sviluppi nella modellazione computazionale, nella tecnologia dei sensori e nell’integrazione dell’intelligenza artificiale. Man mano che i robot chirurgici diventano più prevalenti nelle sale operatorie di tutto il mondo, la domanda per una modellazione accurata e in tempo reale delle interazioni tra tessuti molli intensificherà, supportando l’orientamento verso procedure minimamente invasive e migliori risultati per i pazienti.

Una delle direzioni più promettenti è l’integrazione di modalità di imaging in tempo reale—come l’ecografia intraoperatoria e l’endoscopia avanzata—direttamente nel flusso di lavoro chirurgico. Aziende come www.intuitive.com e www.medtronic.com stanno già equipaggiando le loro piattaforme robotiche con capacità di imaging avanzato. Nei prossimi cinque anni, questo permetterà un tracciamento più preciso della deformazione dei tessuti e un controllo robotico più reattivo, specialmente quando combinato con algoritmi di apprendimento automatico addestrati su ampi dataset del comportamento dei tessuti intraoperatori.

Si prevede che gli approcci basati sui dati passeranno da modelli statici o preoperatori a simulazioni dinamiche specifiche per il paziente. Iniziative come il www.surgicalroboticslab.nl stanno sviluppando framework di modellazione in tempo reale che si adattano continuamente ai cambiamenti tissutali durante la chirurgia. Entro il 2030, si prevede che tali modelli adattativi saranno incorporati regolarmente nei sistemi commerciali, facilitando una navigazione più sicura in tessuti delicati o altamente vascolarizzati.

La fusione dei sensori—combinando feedback di forza, tattili e visivi—maturerà anch’essa, portando a dataset più ricchi per la modellazione cinetica. Ad esempio, www.sensusrobotics.com sta lavorando su sensori tattili avanzati per procedure minimamente invasive. Quando integrati con modelli cinetici, queste tecnologie permetteranno ai robot non solo di “vedere”, ma anche di “sentire” e prevedere il comportamento dei tessuti molli, migliorando l’autonomia e riducendo il carico cognitivo sui chirurghi.

Guardando al futuro, la convergenza del cloud computing e della robotica sbloccherà nuove opportunità nella chirurgia collaborativa e remota. Piattaforme cloud sicure fornite da fornitori come cloud.google.com sono destinate a consentire la condivisione e refinement in tempo reale dei modelli cinetici, accelerando l’apprendimento collettivo e standardizzando le migliori pratiche tra le istituzioni.

In sintesi, gli anni 2025-2030 saranno probabilmente caratterizzati dalla transizione della modellazione cinematica dei tessuti molli da un focus di ricerca a un elemento fondamentale della robotica chirurgica, guidando una maggiore sicurezza, automazione e cura personalizzata per i pazienti in tutto il mondo.

Fonti e Riferimenti

- www.intuitive.com

- www.medtronic.com

- www.surgicalroboticslab.nl

- www.siemens-healthineers.com

- www.ros.org

- www.aami.org

- www.philips.com

- www.robocath.com

- ec.europa.eu

- www.ati-ia.com

- cloud.google.com